En fait. Le 14 avril, le président du Centre national du cinéma et de l’image animée (CNC), Gaëtan Bruel, a indiqué à Edition Multimédi@ que le Fonds d’aide à la création sur les plateformes sociales ne fait pas l’objet d’un arrêt mais d’« une suspension temporaire », à la suite des « pressions extrêmement fortes ».

En clair. « C’est une suspension temporaire et non un arrêt, pour préserver les agents du CNC et les membres de la commission concernée qui ont fait l’objet de pressions extrêmement fortes, notamment de menaces caractérisées », indique à Edition Multimédi@ Gaëtan Bruel, président du Centre national du cinéma et de l’image animée (CNC).

Il avait avait annoncé le 8 avril « suspendre jusqu’à nouvel ordre » les travaux de la commission du Fonds d’aide à la création sur les plateformes sociales en raison d’« une polémique mettant en cause certains projets aidés par l’ancien fonds “CNC Talent” abrogé en juin 2025 et négligeant un certain nombre de faits » et d’« un niveau d’agressivité inédit, y compris sous la forme de menaces à l’encontre des membres de cette commission et d’agents du CNC » (1). Cette polémique couvait depuis plusieurs semaines, alimentée par la droite et l’extrême droite qui ont accusé de partialité la commission du Fonds d’aide à la création sur les plateformes sociales, lequel est (suite)

Le texte sur le copyright et l’IA adopté le 10 mars 2026 à Strasbourg par le Parlement européen – intitulé « Résolution sur le droit d’auteur et l’intelligence artificielle générative – opportunités et défis » (

Le texte sur le copyright et l’IA adopté le 10 mars 2026 à Strasbourg par le Parlement européen – intitulé « Résolution sur le droit d’auteur et l’intelligence artificielle générative – opportunités et défis » ( La proposition de loi instaurant une « présomption d’exploitation des contenus culturels par les fournisseurs d’intelligence artificielle », déposée au Sénat le 12 décembre 2025, sera-t-elle examinée en ce début 2026 ? Rien n’est moins sûr, car ce texte – concocté en plein lobbying d’organisations d’ayants droits et sur recommandation d’une mission du ministère de la Culture conduite par le Conseil supérieur de la propriété littéraire et artistique (CSPLA) – soulève des questions et des réserves de la part des entreprises visées et du gouvernement.

La proposition de loi instaurant une « présomption d’exploitation des contenus culturels par les fournisseurs d’intelligence artificielle », déposée au Sénat le 12 décembre 2025, sera-t-elle examinée en ce début 2026 ? Rien n’est moins sûr, car ce texte – concocté en plein lobbying d’organisations d’ayants droits et sur recommandation d’une mission du ministère de la Culture conduite par le Conseil supérieur de la propriété littéraire et artistique (CSPLA) – soulève des questions et des réserves de la part des entreprises visées et du gouvernement. Tobias Holzmüller (photo), le PDG de la Gema, qui est en Allemagne ce que la Sacem est en France, peut être fier du verdict historique obtenu en première instance du tribunal régional de Munich le 11 novembre 2025 : la manière dont OpenAI gère actuellement ChatGPT viole les lois européennes applicables sur le droit d’auteur. « Pour la première fois en Europe, l’argument en faveur de l’utilisation par les systèmes d’IA générative d’œuvres protégées par le droit d’auteur a été examiné juridiquement et statué en faveur des créateurs des œuvres », s’est félicitée la Société pour les droits d’exécution musicale et de reproduction mécanique (Gema).

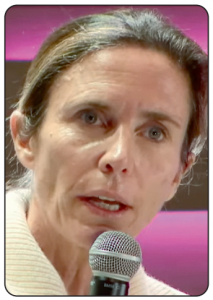

Tobias Holzmüller (photo), le PDG de la Gema, qui est en Allemagne ce que la Sacem est en France, peut être fier du verdict historique obtenu en première instance du tribunal régional de Munich le 11 novembre 2025 : la manière dont OpenAI gère actuellement ChatGPT viole les lois européennes applicables sur le droit d’auteur. « Pour la première fois en Europe, l’argument en faveur de l’utilisation par les systèmes d’IA générative d’œuvres protégées par le droit d’auteur a été examiné juridiquement et statué en faveur des créateurs des œuvres », s’est félicitée la Société pour les droits d’exécution musicale et de reproduction mécanique (Gema). « Il est important d’apporter des clarifications sur des croyances, ou peut-être des raccourcis qui sont faits, par rapport à la nature de YouTube – lequel est bien spécifique, bien unique et pérenne puisque cela faire 20 ans que nous accompagnons et soutenons la création. Et cela veut dire d’abord par commencer à la protéger, avec un modèle économique », a déclaré Justine Ryst (photo), directrice générale YouTube France et Europe du Sud, le 8 novembre lors des 35es Rencontres cinématographiques de L’ARP (

« Il est important d’apporter des clarifications sur des croyances, ou peut-être des raccourcis qui sont faits, par rapport à la nature de YouTube – lequel est bien spécifique, bien unique et pérenne puisque cela faire 20 ans que nous accompagnons et soutenons la création. Et cela veut dire d’abord par commencer à la protéger, avec un modèle économique », a déclaré Justine Ryst (photo), directrice générale YouTube France et Europe du Sud, le 8 novembre lors des 35es Rencontres cinématographiques de L’ARP (