La France va se doter – si une loi était adoptée en 2026 – d’une gouvernance sectorielle pour l’IA, pilotée par la Direction générale de la concurrence, de la consommation et de la répression des fraudes (DGCCRF). Mais la multiplicité des régulateurs pourrait compliquer la tâche des entreprises.

Par Antoine Gravereaux, avocat associé*, FTPA Avocats

La Direction générale des entreprises (DGE), qui dépend du ministère de l’Economie et des Finances, a publié le 9 septembre 2025 un projet de désignation des autorités nationales chargées de la mise en œuvre en France du règlement européen sur l’intelligence artificielle (AI Act). Sous la coordination de la DGE et de la Direction générale de la concurrence, de la consommation et de la répression des fraudes (DGCCRF), ce projet instaure un schéma décentralisé et sectoriel de gouvernance s’appuyant sur les régulateurs existants en France.

La Direction générale des entreprises (DGE), qui dépend du ministère de l’Economie et des Finances, a publié le 9 septembre 2025 un projet de désignation des autorités nationales chargées de la mise en œuvre en France du règlement européen sur l’intelligence artificielle (AI Act). Sous la coordination de la DGE et de la Direction générale de la concurrence, de la consommation et de la répression des fraudes (DGCCRF), ce projet instaure un schéma décentralisé et sectoriel de gouvernance s’appuyant sur les régulateurs existants en France.

La DGCCRF centralise la coordination

Ce modèle s’inscrit dans le cadre de l’AI Act (1) et des dispositions de son article 70 qui impose la désignation d’autorités nationales de notification et de surveillance du marché dans chaque Etat membre. Cette proposition de gouvernance sectorielle et décentralisée doit être présentée au Parlement sous la forme d’un projet de loi. Il ne sera donc définitif qu’après un vote législatif, très probablement dans le courant du premier semestre 2026. Le schéma retenu par le gouvernement prévoit que la mise en œuvre effective de ce règlement européen sur l’IA sera supervisée par plusieurs autorités compétentes, conformément aux orientations proposées par cet AI Act. Dès lors, les administrations, agences et autorités spécialisées – selon leur secteur d’intervention – auront la charge de contrôler les systèmes d’intelligence artificielle, une fois mis sur le marché ou en service.

La DGCCRF centralisera la coordination opérationnelle entre diverses autorités sectorielles impliquées dans le contrôle des systèmes d’IA. Elle sera ainsi l’interlocuteur principal pour les autorités européennes et facilitera l’échange d’informations et la coopération entre les différents régulateurs nationaux. Elle agira comme un point de contact unique, pour la France auprès des instances européennes, sur les questions liées à la surveillance du marché de l’IA. Ce rôle de coordination s’inscrit dans une organisation bicéphale où la DGCCRF assurera la supervision pratique sur le terrain, tandis que la DGE apportera son soutien à la mise en œuvre de l’AI Act. A ce titre, la DGE jouera un rôle-clé dans l’organisation de la gouvernance nationale de ce règlement européen, notamment en (suite) assurant la représentation française et en veillant à un alignement dans l’application des règles sur tout le territoire national, au sein du Comité européen de l’IA. Cet « AI Board » (2), dont le secrétariat est assuré par le Bureau de l’IA (« AI Office ») de la Commission européenne (3), est une instance qui rassemble les représentants des autorités nationales compétentes pour coordonner l’application – justement harmonisée – du règlement européen « établissant des règles harmonisées concernant l’intelligence artificielle ».

Le souhait du gouvernement français est de permettre une surveillance adaptée, mobilisant les compétences spécifiques de chaque autorité en fonction des usages et risques associés aux systèmes d’IA concernés. Les autorités nationales s’inscriraient ainsi comme des acteurs pivots dans la chaîne de surveillance et de contrôle. En pratique, chaque entreprise ou organisation continuera de s’adresser prioritairement à son régulateur de secteur pour respecter les exigences de l’AI Act. Pour les aspects techniques, l’Agence nationale de la sécurité des systèmes d’information (Anssi) et le Pôle d’expertise de la régulation numérique (PEReN) fourniront un appui transversal aux régulateurs qui bénéficieront d’un « socle mutualisé d’expertises ». Ils pourront ainsi les accompagner dans l’analyse technique, la cybersécurité et l’audit des algorithmes d’IA. La Commission nationale de l’informatique et des libertés (Cnil) et l’Autorité de régulation de la communication audiovisuelle et numérique (Arcom) figurent comme des interlocuteurs majeurs pour les enjeux relatifs à la protection des données et à la régulation des contenus auprès des collectivités publiques. Bercy n’a pas publié le 9 septembre 2025 de rapport complet (4) mais un aperçu du schéma proposé – accompagné d’un graphique (5)) qui identifie le périmètre d’intervention des autorités compétentes selon quatre critères : les pratiques interdites (6), les obligations spécifiques de transparence (7), les systèmes d’IA à haut risque (8), les systèmes d’IA à haut risque (9).

Au titre des pratiques interdites

La DGCCRF et l’Arcom veillent au respect de l’interdiction des systèmes d’IA qui utilisent des techniques subliminales, manipulatrices ou trompeuses, et qui exploitent les vulnérabilités liées à l’âge, au handicap ou à la situation sociale ou économique. La Cnil et la DGCCRF contrôlent le respect de l’interdiction sur les systèmes d’IA dédiés à l’évaluation, la classification ou notation sociale. La Cnil joue un rôle central dans le contrôle des pratiques interdites puisqu’elle est seule chargée du contrôle des autres pratiques interdites : police prédictive, création de bases de données de reconnaissance faciale via moissonnage non ciblé, inférence des émotions sur lieu de travail et établissements d’enseignement, catégorisation biométrique, identification biométrique à distance en temps réel à des fins répressives.

Transparence et IA à haut risque

La DGCCRF et Arcom contrôlent les systèmes d’IA interagissant directement avec les personnes ou générant des contenus synthétiques et hypertrucages. L’Arcom surveille également les systèmes générant ou manipulant des textes destinés à informer le public sur des questions d’intérêt public. La Cnil contrôle, quant à elle, le respect des obligations de transparence concernant les systèmes de reconnaissance des émotions et de catégorisation biométrique. Les autorités de surveillance du marché compétentes pour les systèmes d’IA à haut risque voient leur périmètre élargi pour le contrôle de l’intégration de l’IA dans ces produits classés « à haut risque » selon l’annexe I du règlement IA. Ainsi, par exemple, la DGCCRF est en charge de veiller à la sécurité des jouets, et avec l’Agence nationale de sécurité du médicament et des produits de santé (ANSM) pour les dispositifs médicaux.

Pour les systèmes d’IA à haut risque relevant de l’annexe III, les Hauts fonctionnaires de défense et de sécurité (HFDS) des ministères économiques, financiers, industriels et écologiques contrôlent les IA liées aux infrastructures critiques. L’Autorité de contrôle prudentiel et de résolution (ACPR) contrôle les IA destinées à être utilisées pour évaluer la solvabilité des personnes physiques, établir les notes de crédit, et évaluer les risques et la tarification en matière d’assurance-vie et d’assurance maladie. Le Conseil d’Etat, la Cour de cassation et la Cour des comptes supervisent, quant à eux, les systèmes d’IA mis en service ou utilisés par les autorités judiciaires à des fins d’administration de la justice. Enfin, la Cnil contrôle les IA dans l’enseignement, la formation professionnelle (avec la DGCCRF), les processus démocratiques (avec l’Arcom), la biométrie, la gestion des ressources humaines, les usages répressifs, la migration, l’asile, ainsi que le contrôle des frontières. Le schéma « DGE-DGCCRF » proposé vise à éviter la création d’une superstructure, tout en valorisant l’expertise existante au sein des autorités déjà en place.

Le gouvernement français mise ainsi sur les autorités déjà opérationnelles, qui disposent chacune d’une expertise fine dans leurs domaines respectifs. Cette gouvernance « IA » devrait permettre d’apporter une proximité sectorielle avec les acteurs régulés, ainsi qu’une meilleure compréhension des pratiques spécifiques pour une régulation adaptée et un contrôle plus efficace. Pour autant, et c’est là que le bât blesse, cette gouvernance morcelée pourrait générer une complexité accrue pour les entreprises multi-secteurs, avec des points de contacts multiples et une articulation parfois difficile entre exigences sectorielles et obligations transversales de l’AI Act. Ainsi, les PME risquent d’être confrontées à une multiplicité d’interlocuteurs et à une compréhension plus complexe des règles applicables. En effet, les sociétés devront entreprendre des démarches spécifiques selon leur secteur d’activité, rajoutant alors des points de complexité dans leur mise en conformité aux exigences de l’AI Act. Cette gouvernance éclatée pourrait également entraîner une charge administrative accrue, des difficultés de compréhension des exigences applicables et un risque d’interprétations divergentes entre autorités.

Si la DGCCRF joue un rôle d’orientation clé, la multiplication des intervenants et la fragmentation normative s’avèrent particulièrement complexes pour les PME, qui disposent souvent de ressources juridiques limitées pour mener des programmes de mise en conformité de leurs pratiques. La multiplicité des organismes implique aussi un risque de dilution des responsabilités, surtout en cas d’incidents ou de litiges impliquant différents aspects de l’IA (par exemple, un système de scoring biométrique utilisé à des fins publicitaires). En l’absence d’un chef de file unique clairement identifié, cette configuration peut retarder la prise de décision ou compliquer la coordination des sanctions.

Le Conseil d’Etat, dans une étude publiée en 2022 intitulée « Intelligence artificielle et action publique : construire la confiance, servir la performance » (10), avait préconisé une transformation profonde de la Cnil en autorité nationale de contrôle responsable de la régulation des systèmes d’IA. Il soulignait que pour garantir la cohérence et la sécurité juridique, il serait préférable d’adosser la gouvernance de l’IA à une autorité unique renforcée, la Cnil étant le choix naturel compte tenu de son expérience reconnue en matière de protection des données personnelles et de régulation numérique. Confronté à la diversité des secteurs d’application de l’IA, cette piste a été écartée. La mise en œuvre de l’AI Act et la gouvernance proposée imposent donc aux entreprises une coordination et une gestion rigoureuse de leurs risques. Elles doivent concilier les exigences spécifiques à chaque secteur d’activité tout en assurant une sécurité juridique dans un environnement réglementaire à la fois complexe et en constante évolution.

Les entreprises attendues au tournant

Face aux enjeux de l’intelligence artificielle, les entreprises et organisation devront mettre en place un pilotage rigoureux de leurs pratiques. A ce titre, elles devront identifier et évaluer les risques liés à leurs systèmes d’IA, documenter leur fonctionnement, assurer la transparence des interactions, mettre en place un contrôle humain et des procédures de gestion des incidents, tout en respectant des échéances progressives jusqu’en 2026 pour assurer leur conformité à l’AI Act. Sinon, gare aux sanctions. @

* Antoine Gravereaux est avocat associé chez FTPA Avocats,

au département « Technologies, Data & Cybersécurité ».

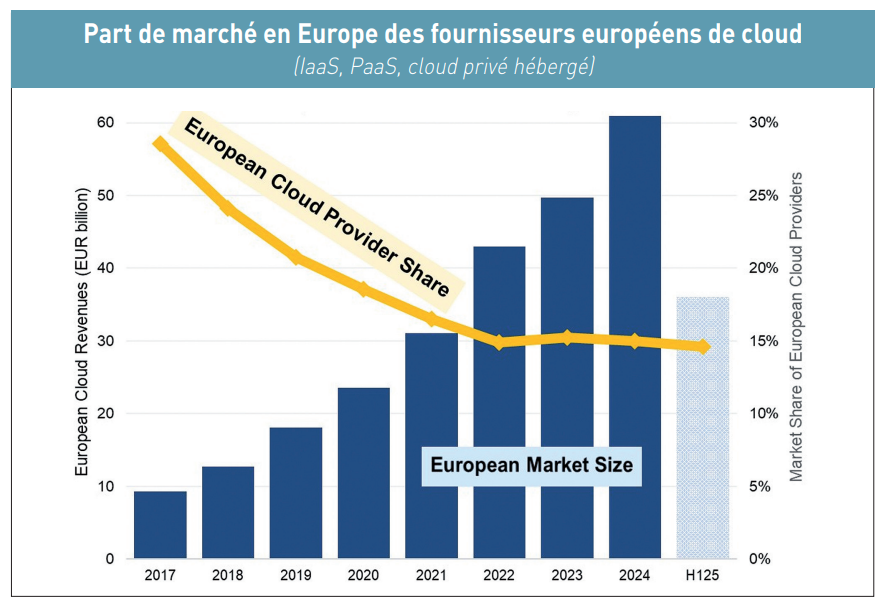

Alors qu’un triumvirat de l’informatique en nuage est en train de se renforcer dans l’Union européenne, constitué par les trois Big Tech américaines Amazon avec Amazon Web Services (AWS), Microsoft avec Microsoft Azur et Google avec Google Cloud, la Commission européenne s’apprête à proposer d’ici la fin de l’année 2025 un projet de règlement sur « le développement de l’informatique en nuage et de l’IA ». Ce Cloud & AI Development Act sera ensuite débattu au Parlement européen début 2026. Pour une entrée en application en 2027 ?

Alors qu’un triumvirat de l’informatique en nuage est en train de se renforcer dans l’Union européenne, constitué par les trois Big Tech américaines Amazon avec Amazon Web Services (AWS), Microsoft avec Microsoft Azur et Google avec Google Cloud, la Commission européenne s’apprête à proposer d’ici la fin de l’année 2025 un projet de règlement sur « le développement de l’informatique en nuage et de l’IA ». Ce Cloud & AI Development Act sera ensuite débattu au Parlement européen début 2026. Pour une entrée en application en 2027 ? Changer de cloud facilement, sans frais

Changer de cloud facilement, sans frais

Seulement certains fournisseurs de systèmes d’IA à usage général – souvent désignés par le sigle GPAI pour General-Purpose AI – ouvrent à partir du 2 août 2025 le bal des obligations prévues par le règlement européen sur l’intelligence artificielle – appelé aussi AI Act (

Seulement certains fournisseurs de systèmes d’IA à usage général – souvent désignés par le sigle GPAI pour General-Purpose AI – ouvrent à partir du 2 août 2025 le bal des obligations prévues par le règlement européen sur l’intelligence artificielle – appelé aussi AI Act ( Bonnes pratiques et lignes directrices

Bonnes pratiques et lignes directrices  L’Union européenne a une ambition manifeste : réguler de manière exemplaire la transition numérique. Du règlement sur l’intelligence artificielle (AI Act) aux directives concernant les services numériques (DSA/DMA), en passant par la régulation des actifs numériques (MiCA) et la résilience opérationnelle du secteur financier (DORA), le législateur européen ne cesse d’introduire des normes structurantes. Chacun de ces textes, pris séparément, a pour objectif de pallier une carence. Ensemble, ils constituent un écosystème réglementaire complexe, parfois dépourvu de cohérence, souvent difficile à appliquer.

L’Union européenne a une ambition manifeste : réguler de manière exemplaire la transition numérique. Du règlement sur l’intelligence artificielle (AI Act) aux directives concernant les services numériques (DSA/DMA), en passant par la régulation des actifs numériques (MiCA) et la résilience opérationnelle du secteur financier (DORA), le législateur européen ne cesse d’introduire des normes structurantes. Chacun de ces textes, pris séparément, a pour objectif de pallier une carence. Ensemble, ils constituent un écosystème réglementaire complexe, parfois dépourvu de cohérence, souvent difficile à appliquer. Il y a près de trois ans, le 21 avril 2021, la Commission européenne a proposé un règlement visant à établir des règles harmonisées concernant l’intelligence artificielle (IA). Ce règlement européen, appelé AI Act, a fait l’objet, le 9 décembre 2023 lors des trilogues (

Il y a près de trois ans, le 21 avril 2021, la Commission européenne a proposé un règlement visant à établir des règles harmonisées concernant l’intelligence artificielle (IA). Ce règlement européen, appelé AI Act, a fait l’objet, le 9 décembre 2023 lors des trilogues (