« La censure de TikTok en Nouvelle-Calédonie […] semble illégale », titrions-nous dans Edition Multimédi@ n°322 daté du 27 mai. Le même jour, La Quadrature du Net déposait devant le Conseil d’Etat – lequel a rejeté le 23 mai son précédent recours – un recours en excès de pouvoir cette fois.

« Bien que le blocage de TikTok soit levé [depuis le 29 mai 2024, ndlr], le précédent politique et juridique existe désormais. Nous pensons qu’il faut tout faire pour que celui-ci ne se reproduise pas et reste un cas isolé. Que ce soit par la Cour européenne des droits de l’homme ou par le Comité des droits de l’homme des Nations unies, ce type de censure est unanimement condamné. Nous ne pouvons donc pas laisser le Conseil d’Etat se satisfaire de ce blocage et devons exiger de lui qu’il rappelle le droit et sanctionne le gouvernement », a expliqué le 5 juin La Quadrature du Net (LQDN), l’association de promotion et de défense des libertés fondamentales dans l’environnement numérique.

« Bien que le blocage de TikTok soit levé [depuis le 29 mai 2024, ndlr], le précédent politique et juridique existe désormais. Nous pensons qu’il faut tout faire pour que celui-ci ne se reproduise pas et reste un cas isolé. Que ce soit par la Cour européenne des droits de l’homme ou par le Comité des droits de l’homme des Nations unies, ce type de censure est unanimement condamné. Nous ne pouvons donc pas laisser le Conseil d’Etat se satisfaire de ce blocage et devons exiger de lui qu’il rappelle le droit et sanctionne le gouvernement », a expliqué le 5 juin La Quadrature du Net (LQDN), l’association de promotion et de défense des libertés fondamentales dans l’environnement numérique.

Recours d’urgence versus mesure d’urgence

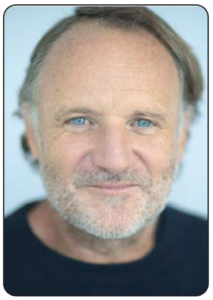

Le recours de près d’une trentaine de pages (1) daté du 27 mai 2024 et signé par Alexis Fitzjean Ó Cobhthaigh (photo), avocat au barreau de Paris, demande au Conseil d’Etat d’annuler la décision attaquée, à savoir celle prise le 14 mai dernier par le Premier ministre qui a ordonné le blocage de TikTok sur l’ensemble de la Nouvelle-Calédonie. Et ce, dans un contexte de sérieux troubles sur l’archipel où l’état d’urgence avait été décrété – pour douze jours légaux maximum – le 15 mai et l’armée déployée pour sécuriser les ports et aéroport de Nouvelle-Calédonie (2). De nombreuses voix se sont exprimées sur le réseau social en Nouvelle-Calédonie contre la réforme constitutionnelle visant à élargir le corps électoral de ce territoire, projet contesté par les indépendantistes. Des émeutes et des violences ont eu lieu.

Le blocage sans précédent en France (tous territoires confondus) avait aussitôt été attaqué en justice par deux organisations, La Quadrature du Net (LQDN) et la Ligue des droits de l’homme (LDH), ainsi que par trois Néo-Calédoniens. Ces premiers recours distincts en urgence devant le Conseil d’Etat avaient été déposés le 17 mai. Le juge des référés de la haute juridiction administrative avait ensuite le 21 mai donné 24 heures au gouvernement pour apporter les preuves écrites et/ou visuelles (images, vidéo, …) pouvant justifier le blocage de TikTok pour des raisons en rapport avec des « actes de terrorisme ». Le Premier ministre Gabriel Attal pourrait-il vraiment s’appuyer sur la loi du 3 avril 1955 sur l’état d’urgence justement, dont l’article 11 prévoit que « le ministre de l’Intérieur peut prendre toute mesure pour assurer l’interruption de tout service de communication au public en ligne, provoquant à la commission d’actes de terrorisme ou en faisant l’apologie » (3) ?

Quatre mois après la Journée mondiale de la radio initiée par l’Unesco (ce fut le 13 février cette année), la quatrième édition de la Fête de la radio a eu lieu en France les 6 et 7 juin, événement lancé en 2021 à l’initiative de l’Arcom – via une association conventionnée (

Quatre mois après la Journée mondiale de la radio initiée par l’Unesco (ce fut le 13 février cette année), la quatrième édition de la Fête de la radio a eu lieu en France les 6 et 7 juin, événement lancé en 2021 à l’initiative de l’Arcom – via une association conventionnée ( C’est le premier coup de gueule de Carine Fouteau (photo), cette journaliste qui a succédé en mars 2024 à Edwy Plenel à la présidence de la Société éditrice de Mediapart. La nouvelle directrice de la publication de Mediapart a dénoncé fin avril « l’opacité des Gafam » en général et « l’absence de transparence » de Google en particulier. Le média d’investigation reproche notamment « les clauses de confidentialité imposées par Google » dans le cadre de l’accord que ce dernier a signé en octobre 2023 avec la Société des droits voisins de la presse (DVP).

C’est le premier coup de gueule de Carine Fouteau (photo), cette journaliste qui a succédé en mars 2024 à Edwy Plenel à la présidence de la Société éditrice de Mediapart. La nouvelle directrice de la publication de Mediapart a dénoncé fin avril « l’opacité des Gafam » en général et « l’absence de transparence » de Google en particulier. Le média d’investigation reproche notamment « les clauses de confidentialité imposées par Google » dans le cadre de l’accord que ce dernier a signé en octobre 2023 avec la Société des droits voisins de la presse (DVP). C’est le grand paradoxe de Believe : le streaming musical a explosé sur les plateformes numériques, mais pas le cours de Bourse de la petite major de la musique enregistrée. Au niveau mondial, d’après la Fédération internationale de l’industrie phonographique (IFPI), la musique en streaming a généré l’an dernier un total de 19,3 milliards de dollars de revenus – soit une hausse de 10,2 % sur un an. Tandis que le chiffre d’affaires de Believe a grimpé de 15,7 % pour atteindre 880,3 millions d’euros (avec une perte nette ramenée à 2,7 millions au lieu de 25 millions l’année précédente). Pourtant, les investisseurs boursiers ne semblent pas croire en la société Believe qui a été introduite mi-2021 à la Bourse de Paris (Euronext) au prix de 19,50 par action.

C’est le grand paradoxe de Believe : le streaming musical a explosé sur les plateformes numériques, mais pas le cours de Bourse de la petite major de la musique enregistrée. Au niveau mondial, d’après la Fédération internationale de l’industrie phonographique (IFPI), la musique en streaming a généré l’an dernier un total de 19,3 milliards de dollars de revenus – soit une hausse de 10,2 % sur un an. Tandis que le chiffre d’affaires de Believe a grimpé de 15,7 % pour atteindre 880,3 millions d’euros (avec une perte nette ramenée à 2,7 millions au lieu de 25 millions l’année précédente). Pourtant, les investisseurs boursiers ne semblent pas croire en la société Believe qui a été introduite mi-2021 à la Bourse de Paris (Euronext) au prix de 19,50 par action. La société vosgienne DStorage fête ses 15 ans, ayant été créée le 9 avril 2009 par son PDG Nessim Yohan Tordjman, un ancien administrateur systèmes et réseaux de chez Free durant dix ans. Elle exploite notamment le site d’hébergement 1fichier.com, qui est souvent désigné depuis plus de dix ans comme « site illicite » ou « site illégal » par les ayants droit. Mais que cela soit devant la justice ou auprès des médias, DStorage ne cesse de défendre la légalité de son service de stockage.

« Pas plus illicite que Wetransfer ou Google Drive »

Ce fut encore le cas fin mars, DStorage ayant obtenu de l’Association de la lutte contre la piraterie audiovisuelle (Alpa) un « droit de réponse » qui, selon les constatations de Edition Multimédi@, a été inséré dans sa dernière étude « Audience des sites illicites dédiés à la consommation vidéo en France ». Celle-ci montre l’évolution du piratage audiovisuel sur Internet de décembre 2021 à décembre 2023. Cette étude mise en ligne le 7 mars dernier a été commanditée auprès de Médiamétrie par l’Alpa, présidée depuis plus de 20 ans par Nicolas Seydoux (photo).

Le site 1fichier.com y est désigné comme étant en tête du « Top 10 » des « sites illégaux les plus utilisés », avec plus de 1,3 million de visites uniques sur le mois de décembre 2023, devant Yggtorrent.qa (0,65 million) ou encore Wawacity.autos (0,5 million). Toujours en décembre 2023, 1fichier.com dépasse même le site légal Paramount+ en termes d’audience. Le droit de réponse est apparu dans l’étude quelques jours après sa publication, soit fin mars (

La société vosgienne DStorage fête ses 15 ans, ayant été créée le 9 avril 2009 par son PDG Nessim Yohan Tordjman, un ancien administrateur systèmes et réseaux de chez Free durant dix ans. Elle exploite notamment le site d’hébergement 1fichier.com, qui est souvent désigné depuis plus de dix ans comme « site illicite » ou « site illégal » par les ayants droit. Mais que cela soit devant la justice ou auprès des médias, DStorage ne cesse de défendre la légalité de son service de stockage.

« Pas plus illicite que Wetransfer ou Google Drive »

Ce fut encore le cas fin mars, DStorage ayant obtenu de l’Association de la lutte contre la piraterie audiovisuelle (Alpa) un « droit de réponse » qui, selon les constatations de Edition Multimédi@, a été inséré dans sa dernière étude « Audience des sites illicites dédiés à la consommation vidéo en France ». Celle-ci montre l’évolution du piratage audiovisuel sur Internet de décembre 2021 à décembre 2023. Cette étude mise en ligne le 7 mars dernier a été commanditée auprès de Médiamétrie par l’Alpa, présidée depuis plus de 20 ans par Nicolas Seydoux (photo).

Le site 1fichier.com y est désigné comme étant en tête du « Top 10 » des « sites illégaux les plus utilisés », avec plus de 1,3 million de visites uniques sur le mois de décembre 2023, devant Yggtorrent.qa (0,65 million) ou encore Wawacity.autos (0,5 million). Toujours en décembre 2023, 1fichier.com dépasse même le site légal Paramount+ en termes d’audience. Le droit de réponse est apparu dans l’étude quelques jours après sa publication, soit fin mars (