En fait. Le 9 avril, Linda Griffin, chargée des affaires publiques mondiales de Mozilla, éditeur du navigateur Firefox, a accusé Microsoft de pratiques anticoncurrentielles sur le marché des navigateurs web et de l’intelligence artificielle. Et pour la Browser Choice Alliance, il y a violation du DMA.

En clair. « Microsoft a récemment annoncé qu’il retirait Copilot de plusieurs de ses applications Windows essentielles – Photos, Notepad [bloc-notes, ndlr], Snipping Tool [outil de capture d’écran, ndlr] et les widgets. Revenir sur ces intégrations forcées d’IA est la bonne décision, mais ce n’est que l’exemple le plus récent de Microsoft allant trop loin sans le consentement des utilisateurs », a pointé Linda Griffin, chargée des affaires publiques de Mozilla, éditeur du navigateur Firefox, dans un blog daté du 9 avril 2026. Microsoft a en effet annoncé, le 20 mars, qu’il « réduis[ait] les points d’entrée inutiles de Copilot, en commençant par des applications comme Snipping Tool, Photos, Widgets et Notepad » (1). C’est une manière de moins favoriser son IA générative Copilot dans son écosystème dominant Windows, même si d’autres logiciels intégrés (Paint, File Explorer, Clipchamp, Outlook ou encore Teams) continue à la mettre en avant.

La firme de Redmond (Etat de Washington), dont le siège européen est à Dublin en Irlande, donnerait-il des gages aux autorités antitrust en Europe qu’elle ne s’y prendrait pas autrement. Microsoft se sait (suite)

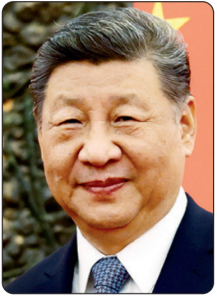

Cela restera comme une première historique depuis la naissance de l’Internet grand public au début des années 1990 : un des géants mondiaux du numérique – l’un des Gafam américains – a été ciblé et touché par un missile, frappe provoquant d’importants dégâts et perturbations. Le 2 avril 2026, le Corps des Gardiens de la Révolution islamique (IRGC) – une organisation paramilitaire dépendant du Guide suprême de la révolution, le chef de l’Etat iranien, l’ayatollah Mojtaba Khamenei (photo) – a revendiqué cette attaque contre Amazon Web Services (AWS), en pleine guerre déclenchée par les Etats-Unis avec Israël contre l’Iran le 28 février (

Cela restera comme une première historique depuis la naissance de l’Internet grand public au début des années 1990 : un des géants mondiaux du numérique – l’un des Gafam américains – a été ciblé et touché par un missile, frappe provoquant d’importants dégâts et perturbations. Le 2 avril 2026, le Corps des Gardiens de la Révolution islamique (IRGC) – une organisation paramilitaire dépendant du Guide suprême de la révolution, le chef de l’Etat iranien, l’ayatollah Mojtaba Khamenei (photo) – a revendiqué cette attaque contre Amazon Web Services (AWS), en pleine guerre déclenchée par les Etats-Unis avec Israël contre l’Iran le 28 février ( L’affaire « Thaler c. Perlmutter » est une affaire qui a débuté en juin 2022, et elle fait encore couler beaucoup d’encre. Le chercheur américain Stephen Thaler, spécialiste reconnu des architectures neuronales et de l’intelligence artificielle, a introduit une action en justice devant le tribunal fédéral du District de Columbia. Dans sa plainte, cet informaticien, physicien et inventeur contestait, au titre de l’Administrative Procedure Act (APA), le refus de l’Office du droit d’auteur des Etats-Unis (US Copyright Office) d’enregistrer l’œuvre « A Recent Entrance to Paradise » (image ci-dessous) générée par son système d’IA Creativity Machine/Dabus.

L’affaire « Thaler c. Perlmutter » est une affaire qui a débuté en juin 2022, et elle fait encore couler beaucoup d’encre. Le chercheur américain Stephen Thaler, spécialiste reconnu des architectures neuronales et de l’intelligence artificielle, a introduit une action en justice devant le tribunal fédéral du District de Columbia. Dans sa plainte, cet informaticien, physicien et inventeur contestait, au titre de l’Administrative Procedure Act (APA), le refus de l’Office du droit d’auteur des Etats-Unis (US Copyright Office) d’enregistrer l’œuvre « A Recent Entrance to Paradise » (image ci-dessous) générée par son système d’IA Creativity Machine/Dabus. Le draft du 15ᵉ plan directeur pour la période 2026-2030, avant que la version finale ne soit approuvée le 12 mars 2026 à Pékin par les législateurs nationaux chinois, est un document de 141 pages détaillant les stratégies de « modernisation » de la Chine pour accélérer son « développement économique et social national ».

Le draft du 15ᵉ plan directeur pour la période 2026-2030, avant que la version finale ne soit approuvée le 12 mars 2026 à Pékin par les législateurs nationaux chinois, est un document de 141 pages détaillant les stratégies de « modernisation » de la Chine pour accélérer son « développement économique et social national ».