C’est la course à l’échalotte du XXIe siècle : après l’IA générative popularisée par ChatGPT lancé par OpenAI il y a deux ans (un siècle !), qui sera l’initiateur de la future superintelligence artificielle censée se mesurer à l’humain ? Cette IAG – ou AGI en anglais – arriverait dès 2025.

Elle est pour demain, ou dans dix ans. Chacun y va de ses prédictions sur l’arrivée prochaine de la « superintelligence artificielle » qui sera comparable à l’intelligence humaine. Deux ans après le lancement de l’IA générative ChatGPT par la société californienne OpenAI, mis en ligne le 30 novembre 2022 précisément (1), voici que son PDG Sam Altman (photo de gauche), prédit l’avènement de l’intelligence artificielle générale (IAG) – Artificial General Intelligence (AGI), en anglais – dès 2025. C’est du moins ce qu’il a laissé entendre le 8 novembre dans un entretien vidéo à Y Combinator (2).

Elle est pour demain, ou dans dix ans. Chacun y va de ses prédictions sur l’arrivée prochaine de la « superintelligence artificielle » qui sera comparable à l’intelligence humaine. Deux ans après le lancement de l’IA générative ChatGPT par la société californienne OpenAI, mis en ligne le 30 novembre 2022 précisément (1), voici que son PDG Sam Altman (photo de gauche), prédit l’avènement de l’intelligence artificielle générale (IAG) – Artificial General Intelligence (AGI), en anglais – dès 2025. C’est du moins ce qu’il a laissé entendre le 8 novembre dans un entretien vidéo à Y Combinator (2).

Sam Altman parle d’une AGI dès 2025

A la fin de l’interview et à la question de Gary Tan, PDG de l’incubateur de start-up Y Combinator, de savoir « ce qui va arriver » l’an prochain, Sam Altman répond à brûle-pourpoint (spontanément, comme sans réfléchir) : « AGI ! … euh… excité pour ça… euh… Qu’est-ce que je suis excité… Hum…[Comme un enfant] je suis plus excité pour cela que jamais ». A force d’être enthousiaste, Sam Altman est-il devenu présomptueux ? Une IA capable de rivaliser avec ou de dépasser l’intelligence humaine verrait le jour en 2025, d’après le PDG cofondateur d’OpenAI.

C’est la première fois qu’il évoque une superintelligence à une échéance si rapprochée, alors que le 23 septembre dernier, il était moins dans l’excitation et la précipitation : « Dans les prochaines décennies, nous serons en mesure de faire des choses qui auraient semblé magiques à nos grands-parents. […] Il est possible que nous ayons une superintelligence dans quelques milliers de jours (!) ; cela peut prendre plus de temps, mais je suis sûr que nous y arriverons. […] Il y a encore beaucoup de détails à résoudre […] », affirmait Sam Altman dans un post intitulé « The Intelligence Age » (3). A raison de 365 jours par an, cela renvoie le lancement d’une superintelligence de type AGI à la fin de la décennie actuelle, pas avant. Et d’ajouter plus loin : « Plus tard, les systèmes d’IA deviendront si performants qu’ils nous aideront à améliorer la prochaine génération de systèmes et à faire des progrès scientifiques dans tous les domaines ». Dans la continuité de l’apprentissage profond (deep learning, en anglais), qui ne cessera pas de s’améliorer grâce à des ressources et des données croissantes, la prochaine étape serait donc le niveau de l’intelligence humaine, voire le dépassement. « Avec une précision étonnante, plus il y a de données et de calculs disponibles, mieux il est possible d’aider les gens à résoudre des problèmes difficiles », résume Sam Altman. Cinq jours après cet entretien, soit le 13 novembre d’après l’agence Bloomberg (4), la direction d’OpenAI réunissait ses équipes en interne pour leur annoncer que la nouvelle intelligence artificielle connue sous le nom de code « Operator » sera lancée en janvier 2025. A usage général, cet « AI agent » (agent IA en français) aura vocation à prendre la main sur l’ordinateur de l’utilisateur pour « exécuter des tâches » à sa place, « comme écrire du code ou réserver un voyage ». Ce nouvel outil sera utilisable à partir d’un navigateur web. Au-delà des IA génératives (ChatGPT, Claude, Gemini, …), la nouvelle course vers les AGI passera par ces agents IA pour ordinateur. (suite)

Anthropic a lancé le sien le 22 octobre, en version bêta en utilisant l’IA générative avancée Claude 3.5 Sonnet. « Au cours des dernières années, de nombreuses étapes importantes ont été franchies dans le développement d’une puissante IA – par exemple, la capacité d’effectuer un raisonnement logique complexe et la capacité de voir et de comprendre des images. La prochaine frontière est l’utilisation de l’ordinateur, indique Anthropic. Le fonctionnement des ordinateurs implique la capacité de voir et d’interpréter les images, en l’occurrence les images d’un écran d’ordinateur. Il faut aussi réfléchir à la façon et au moment d’effectuer des opérations précises en fonction de ce qui est affiché à l’écran » (5). Microsoft, investisseur historique dans OpenAI, a lancé le 16 septembre ses agents IA « Copilot 2e vague » (6) pour automatiser des processus dans la suite des logiciels « 365 » tels que Word, Excel, PowerPoint ou encore Teams. Google prépare aussi son agent IA, d’après The Information. Et après ?

Demis Hassabis : pas d’AGI avant 2033

Après les agents IA, les IAG (AGI) à partir de 2025 ou pas avant 2030 voire au-delà ? Experts et gourous ne sont pas tous d’accord sur l’avènement de ces superintelligences susceptibles de rivaliser avec les humains. Demis Hassabis (photo de droite), PDG cofondateur de la société britannique DeepMind rachetée en janvier 2014 par Google, ne voit pas venir d’intelligence artificielle générale avant une décennie – autrement dit pas avant 2033. C’est en tout cas ce qu’avait dit ce chercheur et entrepreneur britannique en IA l’an dernier lors de la conférence « The Future of Everything Festival » organisée par le Wall Street Journal : « L’intelligence artificielle, un système dans lequel les ordinateurs possèdent des capacités cognitives de niveau humain, pourrait être réalisable en quelques années. […] Les progrès n’ont aucune raison de ralentir ; ils vont s’accélérer et l’on parviendra à une AGI dans seulement dix ans », a expliqué Demis Hassabis (7). Pour que les intelligences artificielles générales puissent être au niveau de l’intelligence humaine, cela suppose de grandes capacités informatiques et quantité de données pour leur apprentissage (machine learning), tant en raisonnement et en tâches cognitives qu’en prises de décision.

Superintelligence, superordinateur ?

Superintelligence, superordinateur ?

Les Big Tech, les Gafam et les hyperscalers américains du cloud tels qu’Amazon Web Services (AWS), Microsoft Azure ou Google Cloud vont-ils préempter le futur marché mondial des superintelligences ? Les besoins en puissances de calculs sont si gigantesques que les solutions alternatives pourraient passer par des superordinateurs en réseaux. C’est par exemple ce que propose la société suisse SingularityNet, fondée par Ben Goertzel (photo ci-contre) avec comme « mission de créer une AGI décentralisée, démocratique, inclusive et bénéfique [qui] n’est pas dépendante d’une entité centrale ». Cette future AGI sera « ouverte à tous » dans le monde, en s’appuyant sur la blockchain. Ce chercheur-entrepreneur américain en IA (8), d’origine brésilienne (il est né en 1966 à Rio de Janeiro), est aussi le fondateur d’OpenCog, un projet open source d’architecture cognitive intégrative qui vise à créer une superintelligence capable de penser et d’apprendre de manière autonome, comme un être humain (9).

Dans le but de démocratiser l’IA, Ben Goertzel a lancé le 13 novembre un fonds de plus de 1 million de dollars pour subventionner – via Deep-Funding (10) – des développeurs capables de « faire progresser l’AGI bienveillante au bénéfice de l’humanité ». Projets de R&D, étudiants, chercheurs ou encore ingénieurs peuvent participer à ce challenge en utilisant le framework logiciel open source OpenCog Hyperon disponible pour « réaliser le rêve de l’AGI » (11).

Les candidats ont jusqu’au 1er décembre pour soumettre leurs propositions (cette date limite pourra être prolongée). « Une fois la subvention accordée, les bénéficiaires auront entre trois et neuf mois pour mener à bien leurs activités de recherche et développement, selon l’ampleur et la complexité du projet », précise dans son appel (12) Ben Goertzel, qui dirige en outre l’Artificial Superintelligence Alliance (ASI Alliance). Cette association a été créée par Fetch.ai, SingularityNet et Ocean Protocol pour développer une AGI open source. Ben Goertzel est un optimiste de l’IA et ne craint pas les avantages des futures superintelligences. Alors que Sam Altman, le patron d’OpenAI, est passé par des crises d’angoisses avant de tenir depuis peu un discours plus positif : « Ce ne sera pas une histoire entièrement positive, mais les avantages sont si énormes que nous devons à nous-mêmes et à l’avenir de trouver comment naviguer dans les risques qui se présentent à nous, a-til écrit le 23 septembre dans son billet “The Intelligence Age” déjà mentionné. Par exemple, nous prévoyons que cette technologie peut entraîner un changement important sur les marchés du travail (bon et mauvais) dans les années à venir, mais la plupart des emplois changeront plus lentement que ne le pensent la plupart des gens, et je n’ai pas peur que nous manquions de choses à faire. […] Et si nous pouvions faire un saut de cent ans dans le futur, la prospérité autour de nous serait tout aussi inimaginable ».

Le PDG d’OpenAI ne fait donc plus dans le catastrophisme, comme lorsque le 17 mai 2023 devant le Sénat américain il avait fait part de sa peur de voir une superintelligence provoquer de « graves dommages au monde ». Il avait alors été cosignataire, avec Bill Gates, Dario Amodei (Anthropic) et d’autres, d’une courte déclaration mise en ligne le 30 mai 2023 : « La réduction du risque d’extinction [de l’humanité, ndlr] dû à l’IA devrait être une priorité mondiale, aux côtés d’autres risques sociétaux tels que les pandémies et la guerre nucléaire » (13). Les craintes se le disputant à la psychose, Elon Musk – pourtant réputé libertarien téméraire – fut parmi les milliers de cosignataires de la « Pause Giant AI Experiments » (14) publiée le 22 mars 2023. Ils appelaient « tous les laboratoires d’IA à suspendre immédiatement pendant au moins six mois la formation des systèmes d’IA plus puissants que GPT-4 ». En vain : OpenAI a lancé GPT-4o en mai dernier (15), où « o » veut dire « omni » car capable de traiter des entrées multimodales (texte, image, audio, l’image et vidéo) et GPT-5 alias Orion verra le jour en décembre 2024 ou début 2025.

L’AGI dira-t-elle « Je pense, donc je suis » ?

Actuellement testé sous le nom de projet « Orion », GPT5 devrait avoir une multimodalité plus puissante en s’appuyant sur une taille de modèle d’IA (grand modèle de langage ou LLM) encore plus grande. Successivement désigné sous les noms de code « Q* » puis « Strawberry », ce nouveau modèle d’OpenAI s’appelle depuis septembre « OpenAI o1 » et est capable de raisonner en temps réel et de résoudre des problèmes complexes comme un humain (16). Il est la pierre angulaire d’Orion/GPT-5 et probablement de la prochain AGI susceptible de « penser » comme un humain. @

Charles de Laubier

![]()

![]()

![]()

![]()

![]()

Après avoir été la première capitalisation boursière mondiale, le groupe Nvidia est redevenu la seconde à 3.314 milliards de dollars au 29 novembre 2024 (au moment où nous bouclons ce numéro de Edition Multimédi@), derrière Apple (3.551 milliards de dollars), Microsoft (3.144 milliards), Amazon (2.163 milliards) ou encore Alphabet/ Google (2.080 milliards), d’après CompaniesMarketCap (

Après avoir été la première capitalisation boursière mondiale, le groupe Nvidia est redevenu la seconde à 3.314 milliards de dollars au 29 novembre 2024 (au moment où nous bouclons ce numéro de Edition Multimédi@), derrière Apple (3.551 milliards de dollars), Microsoft (3.144 milliards), Amazon (2.163 milliards) ou encore Alphabet/ Google (2.080 milliards), d’après CompaniesMarketCap ( Quasi-monopole de puces GPU et IA

Quasi-monopole de puces GPU et IA  Elle est pour demain, ou dans dix ans. Chacun y va de ses prédictions sur l’arrivée prochaine de la « superintelligence artificielle » qui sera comparable à l’intelligence humaine. Deux ans après le lancement de l’IA générative ChatGPT par la société californienne OpenAI, mis en ligne le 30 novembre 2022 précisément (

Elle est pour demain, ou dans dix ans. Chacun y va de ses prédictions sur l’arrivée prochaine de la « superintelligence artificielle » qui sera comparable à l’intelligence humaine. Deux ans après le lancement de l’IA générative ChatGPT par la société californienne OpenAI, mis en ligne le 30 novembre 2022 précisément ( Superintelligence, superordinateur ?

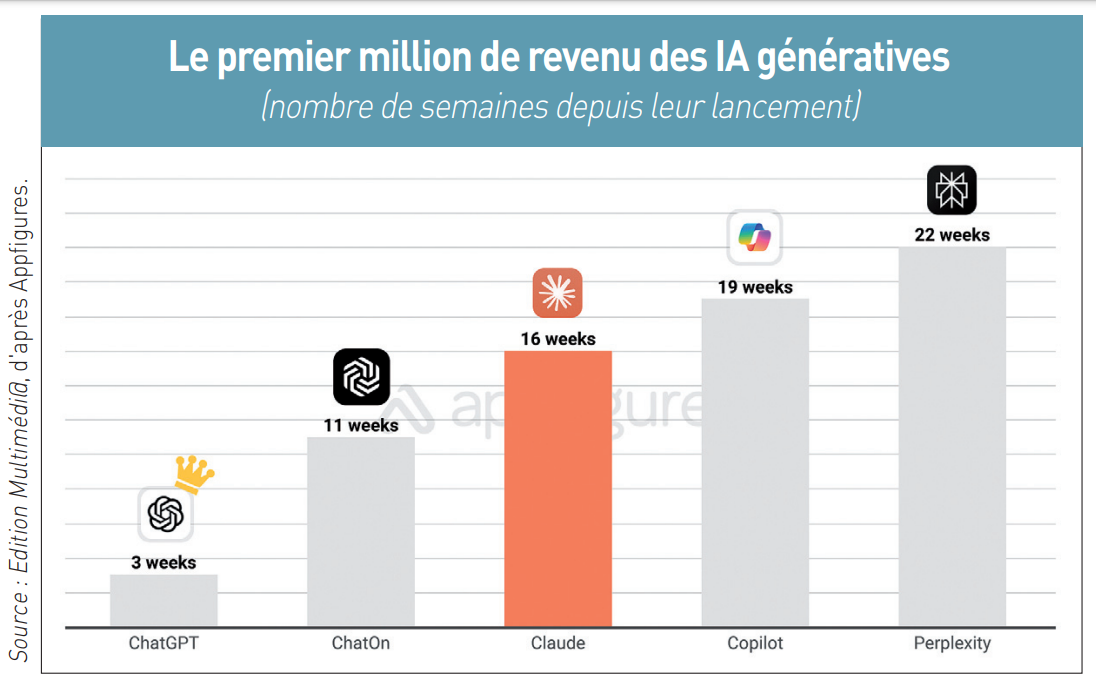

Superintelligence, superordinateur ?  Claude d’Anthropic sera-t-elle l’IA générative qui pourra détrôner ChatGPT d’OpenAI ? L’avenir dira si la fable du lièvre et de la tortue s’appliquera à ces deux concurrents Alors que ChatGPT d’OpenAI a été lancé le 30 novembre 2022 avec le succès médiatique planétaire que l’on connaît (

Claude d’Anthropic sera-t-elle l’IA générative qui pourra détrôner ChatGPT d’OpenAI ? L’avenir dira si la fable du lièvre et de la tortue s’appliquera à ces deux concurrents Alors que ChatGPT d’OpenAI a été lancé le 30 novembre 2022 avec le succès médiatique planétaire que l’on connaît ( Anthropic a donc plus que jamais une carte à jouer dans la bataille des IA génératives, comme le croit Ariel Michaeli : « Nous estimons que Claude a jusqu’à présent 25.000 abonnés payants. Cela semble beaucoup, mais ChatGPT a ajouté 291.000 nouveaux abonnés payants en juillet [l’IA générative d’OpenAI revendiquant en août plus de 200 millions d’utilisateurs actifs, ndlr]. Pour que Claude ait une chance, il doit apprendre des wrappers et ne pas copier ChatGPT. Si Claude augmente son interface de chat avec des fonctionnalités plus grand public, et s’il promeut son application mobile, alors il pourrait avoir une chance » (

Anthropic a donc plus que jamais une carte à jouer dans la bataille des IA génératives, comme le croit Ariel Michaeli : « Nous estimons que Claude a jusqu’à présent 25.000 abonnés payants. Cela semble beaucoup, mais ChatGPT a ajouté 291.000 nouveaux abonnés payants en juillet [l’IA générative d’OpenAI revendiquant en août plus de 200 millions d’utilisateurs actifs, ndlr]. Pour que Claude ait une chance, il doit apprendre des wrappers et ne pas copier ChatGPT. Si Claude augmente son interface de chat avec des fonctionnalités plus grand public, et s’il promeut son application mobile, alors il pourrait avoir une chance » (