Le 78e Festival de Cannes se déroule du 13 au 24 mai 2025, avec la 2e édition de la « Compétition immersive » qui célèbre les œuvres de réalité virtuelle ou réalisées – tendance oblige – avec l’intelligence artificielle. Ce sont surtout les IA génératives qui s’apprêtent à révolutionner le 7e Art.

Le calme avant la tempête ? Le monde du cinéma n’échappera pas au tsunami de l’intelligence artificielle. Le Festival de Cannes, qui tient sa 78e édition sur la Croisette durant presque deux semaines (13-24 mai 2025), commence à prendre en compte les films réalisés en tout ou partie par des IA génératives. L’événement international du 7e Art, organisé chaque année par l’Association française du festival international du film (AFFIF), dont Thierry Frémaux (photo) est le délégué général depuis 18 ans, inclut la « Compétition immersive » pour la seconde année consécutive.

Le calme avant la tempête ? Le monde du cinéma n’échappera pas au tsunami de l’intelligence artificielle. Le Festival de Cannes, qui tient sa 78e édition sur la Croisette durant presque deux semaines (13-24 mai 2025), commence à prendre en compte les films réalisés en tout ou partie par des IA génératives. L’événement international du 7e Art, organisé chaque année par l’Association française du festival international du film (AFFIF), dont Thierry Frémaux (photo) est le délégué général depuis 18 ans, inclut la « Compétition immersive » pour la seconde année consécutive.

Trucages, effets spéciaux, IA : continuité ?

Cette année, 16 œuvres immersives venant de neuf pays sont présentées en sélection, dont 9 en compétition et 2 hors compétition. « Ensemble, ces seize propositions offrent une vision d’ensemble d’un langage en pleine mutation – allant de la réalité virtuelle à la réalité mixte, en passant par le mapping vidéo et l’intelligence artificielle. Conçues pour être vécues plutôt que regardées, ces œuvres nous plongent dans des mondes imaginaires où espace, narration et émotion s’entrelacent », a indiqué le Festival de Cannes le 30 avril dernier, à l’occasion des présentations de la sélection et du jury, lequel remettra « le Prix de la meilleure œuvre immersive » lors de la cérémonie de clôture de la compétition immersive prévue le 22 mai prochain (1).

Parmi les œuvres présentées, il y a « Beyond the Vivid Unknown », de John Fitzgerald et Godfrey Reggio, un film qui se distingue par son utilisation notable de l’IA générative. « L’œuvre utilise l’apprentissage automatique génératif et la vision par ordinateur en temps réel pour suivre et répondre à la présence du spectateur. Au fur et à mesure que les participants se déplacent dans l’espace, l’installation passe de paysages intacts à l’essor de l’humanité et au chaos de notre avenir proche, reflétant l’enchevêtrement de l’humanité avec la technologie et impliquant le spectateur dans le récit », expliquent les producteurs américains. Cette œuvre (suite) réimagine ainsi avec l’IA le film-documentaire emblématique de Reggio de 1982, « Koyaanisqatsi », faisant à la fois l’éloge et la critique de la technologie. « “Beyond The Vivid Unknown” marque le moment où la technologie cesse de refléter le monde et commence à le réécrire par l’action collective » (2), est-il expliqué. Il s’agit apparemment de la seule œuvre créée avec de l’IA qui s’est invitée au Festival de Cannes. Parmi les sociétés de production qui ont participé à sa réalisation, il y a notamment Onassis ONX (ex-ONX Studio, pour « Onassis eXtended realities ») que la Fondation Onassis – créée il y a 50 ans par le milliardaire Aristote Onassis, ancien armateur grec – définit comme « une plateforme mondiale pour l’art des nouveaux médias et la culture numérique, où les idées créatives s’entremêlent avec des technologies innovantes, ouvrant la voie à des expériences immersives ». Ce programme mondial soutient ainsi « la créativité dans des domaines tels que l’intelligence artificielle (IA), la réalité virtuelle (RV), l’informatique spatiale et les médias numériques » (3).

Au nom du Festival de Cannes, Thierry Frémaux – qui est par ailleurs directeur de l’Institut Lumière de Lyon – considère que l’IA s’inscrit seulement dans la continuité technologique des trucages et des effets spéciaux utilisés de longue date par le 7e Art. « On peut utiliser l’intelligence artificielle dans le cinéma, à condition que cela soit au service de la poésie. A condition que cela soit au service de la qualité artistique du film. Ça fait bien longtemps que les films sont truffés de trucages numériques, truffés d’effets spéciaux, y compris des films tout à fait réalistes », avait-il confié au média vidéo Brut le 19 mars dernier (4). Trois jours avant, dans La Tribune Dimanche du 16 mars, à la question « Le cinéma doit-il craindre alors l’intelligence artificielle ? », Thierry Frémaux répondait en ces termes : « Non, parce que le cinéma, qui soit dit en passant utilise l’IA depuis des années [vraiment ?, ndlr], ne s’y résumera jamais. Pas plus que ChatGPT ne saura faire surgir “A la recherche du temps perdu”, l’IA ne va pas inventer le monde d’Ozu ou celui de Jacques Demy. Il faut des créateurs. Mais l’intelligence artificielle n’est pas uniquement un épate-gogos : s’il faut être prévenu de ses dangers, elle peut se montrer précieuse » (5).

L’IA s’incruste au Marché du Film

Parallèlement au Festival de Cannes, se tient la 56e édition du Marché du Film, du 13 au 21 mai, où il sera aussi question d’intelligence artificielle parmi les quelques 15.000 participants attendus (4.000 films et projets sont présentés par 140 pays). Par exemple, le 19 mai, une conférence sur le thème « De nouvelles opportunités pour les films de science-fiction à l’ère de l’IA » est présentée par Dreamina AI (plateforme créée par CapCut de ByteDance), en association avec Winston Baker, société spécialisée dans la curation de contenu pour l’industrie du divertissement. Autre exemple de conférence abordant l’IA dans le cinéma : le 20 mai, sur le thème « Immersive Spotlights, Beyond the Vivid Unknown : l’IA en tant que collaboratrice, miroir et créatrice de mythes ». Les participants, dont Matt Tierney, producteur et conseiller en IA/Musique chez OnAi Technologies, partent du principe que « l’IA n’est plus seulement un outil, c’est un collaborateur, un environnement, une force qui remodèle la perception et la production : de “Beyond The Vivid Unknown” aux systèmes d’IA générative d’aujourd’hui, nous explorons comment la créativité change lorsque les machines apprennent, imaginent et agissent à nos côtés ».

Les scénaristes sur la sellette

Les scénaristes sur la sellette

Le 18 mai, il est aussi question d’IA dans le cadre de Cannes Next, une plateforme dédiée à l’innovation et à l’avenir du divertissement, intégrée au Marché du Film du Festival de Cannes, et sur le thème de « Réinventer la production : naviguer dans les innovations en matière d’IA, les entreprises commerciales émergentes et le paysage juridique ». Présentée par l’International Screen Institute, cette conférence considère que « l’innovation basée sur l’IA redéfinit l’avenir de la production audiovisuelle ». Enfin, le 16 mai, s’est tenue un table-ronde sur le thème de « L’objectif créatif : l’évolution du rôle de GenAI dans le cinéma à travers les continents et les festivals », en présence notamment de Matthieu Lorrain, responsable de la création Google DeepMind, et de Max Wiedemann, responsable de l’IA chez Mediawan.

Ainsi, l’IA générative s’impose de plus en plus dans la création cinématographique et audiovisuelle. Elle n’a pas attendu le tapis rouge de la Croisette pour contribuer à la réalisation de films et séries. C’est cas du film « Next Stop Paris », produit par TCLtv+ Studios et sorti à l’été 2024, une comédie romantique entièrement générée par intelligence artificielle, utilisant notamment Stable Diffusion, de la startup Stability AI, pour la création des images et l’amélioration de leur fluidité. En 2023, il y a eu « The Frost », un courtmétrage de science-fiction réalisé par Waymark et sorti en 2023. Ce film de 12 minutes a été entièrement généré grâce à des outils d’IA, notamment Dall·E 2 d’OpenAI pour la création des images et Creative Reality Studio de la start-up israélienne D-ID pour animer les visages et les mouvements des personnages (6). L’IA dans le 7e Art peut susciter et suscitera des réactions épidermiques comme ce fut le cas l’an dernier pour le film « The Last Screenwriter », réalisé par Peter Luisi. Une vive controverse avait éclaté sous prétexte que son scénario avait été entièrement écrit par ChatGPT, ce qui a provoqué des débats sur l’impact de l’IA dans l’industrie cinématographique. La première mondiale, qui avait été programmée le 23 juin 2024 au Prince Charles Cinema de Londres, a dû être annulée après une vague de protestations du public, qui s’inquiétait de l’utilisation de l’IA à la place d’un scénariste humain. Le film a finalement été rendu accessible gratuitement en ligne (7) le 5 juillet suivant, accompagné d’une documentation expliquant son processus de création. Citons encore le film « Uncanny Valley », dont la sortie est prévue en 2026. Il est réalisé par Natasha Lyonne, qui utilise l’IA Marey – développée par Moonvalley – pour générer des visuels et des éléments narratifs. Contrairement à d’autres modèles d’IA, Marey a été entraîné uniquement sur du contenu sous licence, ce qui garantit une approche plus éthique de la production.

De nombreuses autres créations à l’aide de l’IA ont été remarquées telles que le film coréen « One More Pumpkin » qui a été presque entièrement réalisé avec l’IA pour des scènes, des sons ou encore des personnages. Il a remporté des Prix au Festival du Film AI de Dubaï 2024. Pour l’été prochain, il faudra être attentif à la sortie prévue du film « The Woman with Red Hair », produit par Staircase Studios AI, fondé par Pouya Shahbazian. Réalisé par Brett Stuart, avec un scénario écrit par Michael Schatz, ce long-métrage combine l’IA générative avec le talent de professionnels du cinéma pour produire des films à moindre coût. Et avant que ne se lance ChatGPT fin novembre 2022, sortait quelques mois plus tôt le film futuriste « Salt » (8), réalisé par Fabian Stelzer à partir d’IA génératives telles que Dall-E 2, Stable Diffusion et Midjourney.

En France, fin mars, a été lancé The Media Company, un studio de production cinéma européen qui veut « réinventer la création et la production de films à l’ère de l’IA ». En sont associés le producteur français Didier Lupfer (ex-directeur général adjoint du groupe Canal+ et ex-président de StudioCanal), Edouard Boccon-Gibod (ex-secrétaire général d’EuropaCorp) et Tariq Krim (entrepreneur, ex-PDG fondateur de Netvibes). Ils ambitionnent d’« intégrer l’IA dans toutes les étapes de la production » (9). Plus récemment, le 2 mai, le producteur-distributeur français Zed a lancé la série documentaire « Knut, le Viking Empereur », réalisée par Fabrice Buysschaert avec l’IA.

Vers une charte éthique sur l’IA

« L’intelligence artificielle n’est pas une affaire de science-fiction. C’est un levier de transformation très concret pour écrire plus vite, produire plus intelligemment, anticiper mieux », a assuré pour sa part fin avril Alexia Laroche Joubert (photo ci-dessus), directrice générale de Banijay France (10), qui utilise Genario, « une IA pensée par un scénariste et pour les auteurs » (11). L’IA a permis par exemple de simuler un yacht dans « Deal or No Deal Island » ou de créer le trouble dans « Deep Fake Love ». Banijay indique collaborer par ailleurs avec la Human Technology Foundation afin d’approfondir les réflexions éthiques et de se doter d’« une charte pour encadrer nos usages avec exigence et responsabilité ». @

Charles de Laubier

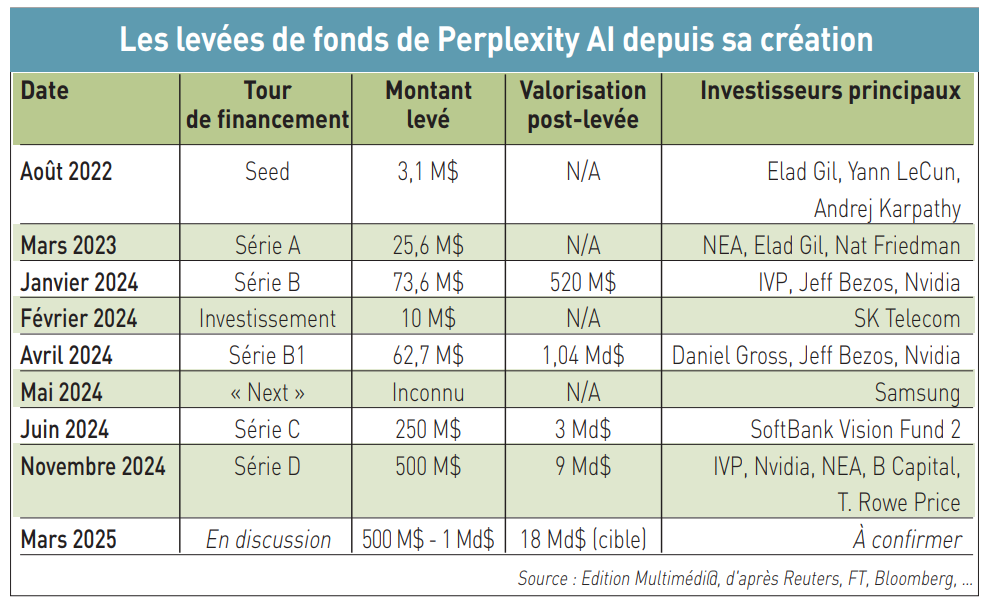

« Perplexity n’est pas un chabot. C’est un outil », avertit sur son site web (

« Perplexity n’est pas un chabot. C’est un outil », avertit sur son site web (

« OpenAI a annoncé en décembre 2024 son intention d’adopter le statut de Public Benefit Corporation (PBC), dans le Delaware, une structure juridique qui permet de concilier objectifs lucratifs et missions d’intérêt général. Cette évolution pourrait faciliter une future entrée en Bourse, bien qu’aucun calendrier précis n’ait été communiqué », a répondu ChatGPT à Edition Multimédi@ sur la future cotation de la célèbre licorne. D’après le chatbotmaison, son PDG Sam Altman (photo) envisage « avec prudence » cette IPO (

« OpenAI a annoncé en décembre 2024 son intention d’adopter le statut de Public Benefit Corporation (PBC), dans le Delaware, une structure juridique qui permet de concilier objectifs lucratifs et missions d’intérêt général. Cette évolution pourrait faciliter une future entrée en Bourse, bien qu’aucun calendrier précis n’ait été communiqué », a répondu ChatGPT à Edition Multimédi@ sur la future cotation de la célèbre licorne. D’après le chatbotmaison, son PDG Sam Altman (photo) envisage « avec prudence » cette IPO ( La Bourse et la vie : modèle hybride

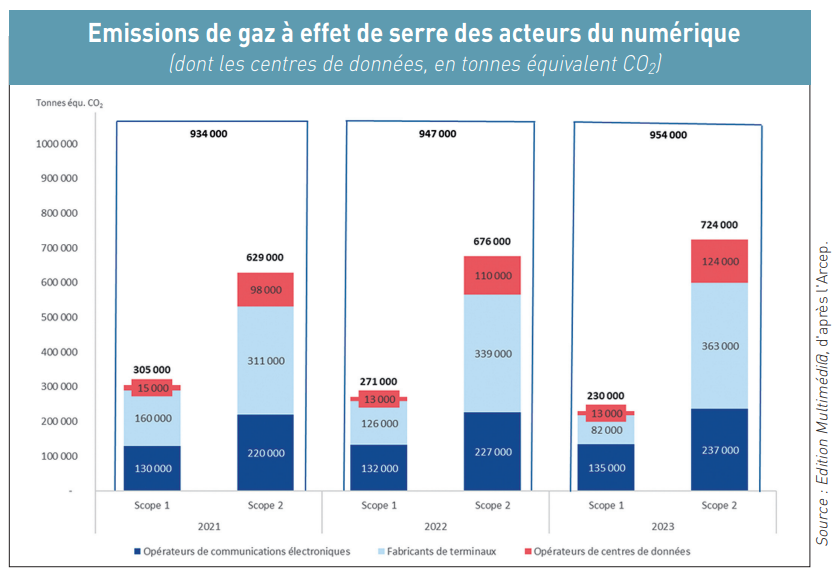

La Bourse et la vie : modèle hybride  Ils s’appellent Amazon Data Services (AWS), Equinix, OVHcloud, Data4, Telehouse, Digital Realty, Atos, Scaleway, ou encore Microsoft Azure. Ce sont les opérateurs de centres de données, dont le marché français – à l’instar de ce qui se passe dans le monde – explose pour répondre à la forte demande de l’intelligence artificielle et des services de cloud. « On entend par centres de données les installations accueillant des équipements de stockage de données numériques », définit officiellement le code des postes et des communications électroniques (CPCE). Et « on entend par opérateur de centre de données toute personne assurant la mise à la disposition des tiers d’infrastructures et d’équipements hébergés dans des centres de données » (

Ils s’appellent Amazon Data Services (AWS), Equinix, OVHcloud, Data4, Telehouse, Digital Realty, Atos, Scaleway, ou encore Microsoft Azure. Ce sont les opérateurs de centres de données, dont le marché français – à l’instar de ce qui se passe dans le monde – explose pour répondre à la forte demande de l’intelligence artificielle et des services de cloud. « On entend par centres de données les installations accueillant des équipements de stockage de données numériques », définit officiellement le code des postes et des communications électroniques (CPCE). Et « on entend par opérateur de centre de données toute personne assurant la mise à la disposition des tiers d’infrastructures et d’équipements hébergés dans des centres de données » (

La suprématie de Google (filiale d’Alphabet) sur le marché mondial des moteurs de recherche reste quasiment inchangée à fin janvier 2025 par rapport à il y a un an, et malgré la déferlante des IA génératives et autres chabots boostés à l’intelligence artificielle. D’après StatCounter, le moteur de recherche Google s’arroge encore 89,78 % de part de marché mondiale dans le search (

La suprématie de Google (filiale d’Alphabet) sur le marché mondial des moteurs de recherche reste quasiment inchangée à fin janvier 2025 par rapport à il y a un an, et malgré la déferlante des IA génératives et autres chabots boostés à l’intelligence artificielle. D’après StatCounter, le moteur de recherche Google s’arroge encore 89,78 % de part de marché mondiale dans le search (