Les fournisseurs de système d’IA et les entreprises utilisatrices de ces solutions – exploitant quantités de données, personnelles comprises – doivent se conformer à plusieurs réglementations européennes : de l’AI Act au RGPD, en passant les directives « Copyright » et « Bases de données ».

Par Arnaud Touati, avocat associé, et Mathilde Enouf, juriste, Hashtag Avocats

L’AI Act – règlement européen sur l’intelligence artificielle (1) – représente un changement significatif dans la régulation technologique au sein des Vingt-sept. Il ne substitue pas aux régimes existants, mais les enrichit, engendrant une superposition complexe avec le règlement général sur la protection des données (RGPD) et la législation sur le droit d’auteur. Cela nécessite des entreprises de mettre en place une gouvernance juridique intégrée, impliquant juristes, techniciens et responsables de la conformité.

L’AI Act – règlement européen sur l’intelligence artificielle (1) – représente un changement significatif dans la régulation technologique au sein des Vingt-sept. Il ne substitue pas aux régimes existants, mais les enrichit, engendrant une superposition complexe avec le règlement général sur la protection des données (RGPD) et la législation sur le droit d’auteur. Cela nécessite des entreprises de mettre en place une gouvernance juridique intégrée, impliquant juristes, techniciens et responsables de la conformité.

Pas d’IA contre les droits fondamentaux

L’incertitude jurisprudentielle, l’accroissement des obligations et le danger financier associé aux sanctions exigent une vigilance accrue. Cependant, cette contrainte peut se transformer en atout concurrentiel : les entreprises qui réussissent à prévoir et à incorporer la conformité progressive gagneront la confiance de leurs utilisateurs et de leurs partenaires. La capacité des acteurs à convertir ces obligations en normes de qualité et de confiance déterminera l’avenir de l’intelligence artificielle (IA) en Europe. La régulation, plutôt que d’être un simple obstacle, pourrait se transformer en un outil stratégique de souveraineté numérique et de développement durable de l’IA.

Première législation mondiale dédiée à cette innovation technologique, l’AI Act est entré en vigueur le 1er août 2024, mais ses obligations sont mises en œuvre progressivement. Les mesures prohibées ont commencé à s’appliquer en février 2025 ; les normes relatives aux modèles d’IA à usage général ont commencé à s’appliquer en août 2025 (2) ; les règles concernant les systèmes à haut risque seront mises en œuvre en août 2026. Cette mise en application progressive a pour but de donner aux entreprises le temps nécessaire pour s’adapter, tout en se concentrant d’abord sur les risques considérés comme les plus critiques. A l’inverse du RGPD, qui a mis en place en 2018 un cadre uniforme immédiatement applicable à tous les traitements de données, l’AI Act opère (suite) sur la base d’une approche progressive. Cette stratégie illustre le désir du législateur européen de soutenir l’innovation tout en prévenant des disruptions trop violentes pour les acteurs économiques. Elle reflète aussi une reconnaissance de la variété des applications de l’IA, certaines étant avantageuses et peu dangereuses, d’autres risquant d’avoir un impact sévère sur les droits fondamentaux. Il s’agit d’une législation structurante qui ne remplace pas le RGPD ni le droit d’auteur, mais qui s’y superpose. La loi sur l’IA se fonde sur une catégorisation des systèmes d’IA en fonction de leur degré de risque. L’IA s’appuie sur l’exploitation d’une grande quantité de données, dont un bon nombre pourrait être considéré comme des données personnelles. Le RGPD rend obligatoire la détermination d’une base légale pour chaque acte de collecte ou d’utilisation (3). Selon la situation, le traitement peut se baser sur le consentement de l’individu concerné, sur l’exécution d’un contrat, sur un devoir légal, sur la protection des intérêts essentiels, sur une tâche d’intérêt public, ou encore sur le bénéfice légitime du gestionnaire du traitement. Ce fondement peut être considéré pour la formation des modèles. Cependant, il doit toujours être précédé d’une évaluation de proportionnalité et d’un contrôle de compatibilité avec les objectifs initiaux de la collecte.

L’obtention de l’accord est primordiale, particulièrement en ce qui concerne les données sensibles telles que définies par l’article 9, ou lorsque les traitements ne sont pas suffisamment justifiés par une autre base légale. De plus, si les données sont réutilisées pour un but différent de celui qui a motivé leur collecte, le RGPD demande une vérification de la concordance de cette nouvelle finalité (4). Cette évaluation prend en considération le rapport entre l’objectif initial et l’objectif modifié, le contexte de la collecte des données, la nature de ces dernières, les implications pour les individus concernés, ainsi que la présence de sécurités comme le cryptage ou la pseudonymisation.

Le droit de s’opposer au profilage

Le RGPD donne également la possibilité aux Etats membres d’établir des règles spécifiques, en particulier pour les traitements basés sur une obligation légale ou une mission d’intérêt public, afin de définir clairement les conditions de légalité et de structurer les modalités pratiques de leur application. Et toute personne a le droit de ne pas être soumise à une décision exclusivement automatisée, y compris le profilage, si cette décision engendre des conséquences juridiques ou a un impact significatif sur elle (5). Trois exceptions sont prévues à ce principe : la décision peut être valide si elle est indispensable à l’application d’un contrat, si elle est stipulée par la législation de l’UE ou d’un Etat membre, ou si elle repose sur l’accord explicite de l’individu concerné. Quoi qu’il en soit, des assurances particulières doivent être mises en place, notamment le droit d’exiger une intervention humaine, de faire part de ses remarques et de contester la décision.

Délicate soumission à plusieurs textes

De plus, le RGPD proscrit la prise de ces décisions sur des types spécifiques de données sensibles (6), à moins que l’une des exceptions ne soit applicable et que des mesures de protection accrues soient instaurées (7). Cette mesure est particulièrement cruciale pour les systèmes d’IA à risque élevé, notamment dans les domaines du crédit, de l’embauche ou de l’assurance, où la ligne entre automatisation et intervention humaine doit être strictement observée.

Concernant cette fois la propriété intellectuelle, l’AI Act exige une plus grande transparence sur les données utilisées pour la formation, sans toutefois établir un droit de refus. Le choix de sortie cité dans certaines études découle de la directive européenne « Droit d’auteur et droits voisins dans le marché unique numérique » de 2019, directive dite « Copyright » (8) : elle établit une dérogation pour l’extraction de textes et de données à des fins scientifiques (9), alors qu’elle permet l’extraction à des fins commerciales, à condition que les détenteurs des droits ne s’y soient pas formellement opposés (10). On peut également mentionner la protection spécifique des bases de données prévue par la directive « Bases de données » de 1996 (11), qui proscrit l’extraction substantielle ou la réutilisation non permise de contenus.

La coordination entre ces divers systèmes d’IA est délicate. Un projet donné peut être soumis à la fois au RGPD, au droit d’auteur, au droit des bases de données et à l’AI Act en même temps. Les obligations peuvent s’accumuler sans forcément être cohérentes entre elles, ce qui contraint les acteurs à adopter une démarche globale de conformité. Cette dernière comprend la sauvegarde des données personnelles, la reconnaissance des droits de propriété intellectuelle, ainsi que les exigences techniques spécifiques au règlement sur l’IA.

Considérons un cas de figure où un générateur de contenus commerciaux utilise des profils d’utilisateurs (RGPD), des articles de presse (droit d’auteur) et des bases documentaires publiques (AI Act). Conformément au RGPD : obligation de communication, protection des droits individuels, assurances pour les transferts internationaux (12). Conformément au « Copyright » : contrôle des licences, observation des opt-out et considération des exceptions. Conformément à l’AI Act : documentation technique, gestion des données, protocoles de traitement des incidents, contrôle humain et évaluation de conformité réalisée par des entités notifiées. En cas d’infractions, l’AI Act instaure un système de sanctions particulièrement dissuasif, qui s’ajoute et parfois se superpose à celui du RGPD, selon trois niveaux de gravité :

• La transgression des prohibitions strictes, telles que manipulation subliminale, exploitation de vulnérabilités, notation sociale, usage abusif de la biométrie, etc., expose les opérateurs à une amende qui pourrait s’élever jusqu’à 35 millions d’euros ou représenter 7 % du chiffre d’affaires annuel global de la société, le montant le plus élevé étant pris en compte (13).

• Les infractions aux obligations imposées à divers intervenants de la chaîne (fournisseurs, mandataires, importateurs, distributeurs, déployeurs) ou aux entités notifiées, ainsi que les violations des règles de transparence (14), sont passibles d’une amende pouvant atteindre 15 millions d’euros ou 3 % du chiffre d’affaires mondial. En définitive, la communication d’informations fausses, partielles ou induisant en erreur aux instances de régulation peut conduire à une sanction pouvant atteindre 7,5 millions d’euros ou 1 % du chiffre d’affaires.

• La réglementation prévoit un régime allégé pour les PME et les start-up, pour lesquels le seuil applicable est le plus bas entre les montants absolus et les pourcentages mentionnés précédemment. L’AI Act précise également les paramètres d’aggravation ou de mitigation pris en compte par les autorités nationales (15). Chaque Etat membre est tenu d’établir des normes procédurales nationales, de définir l’étendue à laquelle les amendes peuvent s’appliquer aux autorités ou institutions publiques, et d’assurer aux opérateurs des voies de recours juridictionnelles effectives.

On prévoit l’émergence des premiers litiges dès 2025, en particulier concernant les pratiques prohibées par l’AI Act (16), en vigueur depuis le 2 février. Dès le 2 août 2026, les conflits pourraient englober les systèmes à haut risque, avec une prolongation jusqu’en 2027 pour certains équipements inclus dans des produits soumis à réglementation, en particulier dans les domaines financier et médical. Etant donné que la Commission européenne a abandonné sa proposition de directive sur la responsabilité civile de l’IA, le cadre repose désormais sur la directive « Responsabilité du fait des produits défectueux » de 2024, qui englobe les systèmes d’IA et doit être mise en œuvre d’ici décembre 2026.

Les entreprises doivent vite se préparer

Pour être prêtes et en conformité, les entreprises doivent mettre en place des procédures internes solides pour anticiper. Cette préparation sera facilitée par des outils utiles tels que des tableaux de comparaison RGPD/AI Act/ Copyright ou des listes de vérification pour assurer la conformité. Quant aux transferts internationaux de données UE-US, ils demeurent un enjeu majeur. Ils restent soumis au RGPD et aux exigences renforcées des arrêts « Schrems », malgré la confirmation fragile en septembre 2025 (17) du Data Privacy Framework. @

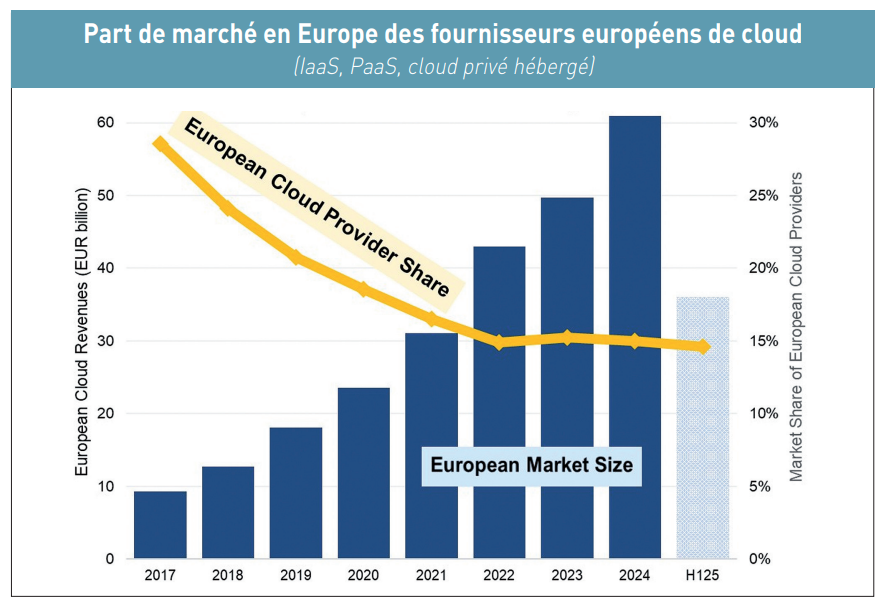

Alors qu’un triumvirat de l’informatique en nuage est en train de se renforcer dans l’Union européenne, constitué par les trois Big Tech américaines Amazon avec Amazon Web Services (AWS), Microsoft avec Microsoft Azur et Google avec Google Cloud, la Commission européenne s’apprête à proposer d’ici la fin de l’année 2025 un projet de règlement sur « le développement de l’informatique en nuage et de l’IA ». Ce Cloud & AI Development Act sera ensuite débattu au Parlement européen début 2026. Pour une entrée en application en 2027 ?

Alors qu’un triumvirat de l’informatique en nuage est en train de se renforcer dans l’Union européenne, constitué par les trois Big Tech américaines Amazon avec Amazon Web Services (AWS), Microsoft avec Microsoft Azur et Google avec Google Cloud, la Commission européenne s’apprête à proposer d’ici la fin de l’année 2025 un projet de règlement sur « le développement de l’informatique en nuage et de l’IA ». Ce Cloud & AI Development Act sera ensuite débattu au Parlement européen début 2026. Pour une entrée en application en 2027 ? Changer de cloud facilement, sans frais

Changer de cloud facilement, sans frais

L’AI Act – règlement européen sur l’intelligence artificielle (

L’AI Act – règlement européen sur l’intelligence artificielle ( Le Tribunal de l’Union européenne (TUE) a rendu, le 3 septembre 2025, une décision (

Le Tribunal de l’Union européenne (TUE) a rendu, le 3 septembre 2025, une décision ( Cinq jours à peine après avoir signé tout sourire avec Ursula von der Leyen (photo de droite) les conclusions d’un accord commercial sur les droits de douane entre les Etats-Unis et l’Union européenne (

Cinq jours à peine après avoir signé tout sourire avec Ursula von der Leyen (photo de droite) les conclusions d’un accord commercial sur les droits de douane entre les Etats-Unis et l’Union européenne ( Henna Virkkunen s’adresse à Jim Jordan

Henna Virkkunen s’adresse à Jim Jordan