Ayant succédé au Sénégalais Abdou Diouf en tant que secrétaire générale de l’Organisation internationale de la francophonie (OIF), lors du XVe Sommet de la francophonie de novembre 2014, la Canadienne Michaëlle Jean (photo) a présenté le 18 mars dernier à Paris le premier rapport sur la « francophonie numérique ».

Par Charles de Laubier

Il y a aujourd’hui 274 millions de francophones dans le monde. Ils seront 700 millions en 2050, soit une personne sur treize. Au moment où est célébrée, ce 20 mars, la Journée internationale de la francophonie (1), le rapport sur la « francophonie numérique » dresse pour la première fois un état des lieux de la langue française et des francophones sur Internet.

Il y a aujourd’hui 274 millions de francophones dans le monde. Ils seront 700 millions en 2050, soit une personne sur treize. Au moment où est célébrée, ce 20 mars, la Journée internationale de la francophonie (1), le rapport sur la « francophonie numérique » dresse pour la première fois un état des lieux de la langue française et des francophones sur Internet.

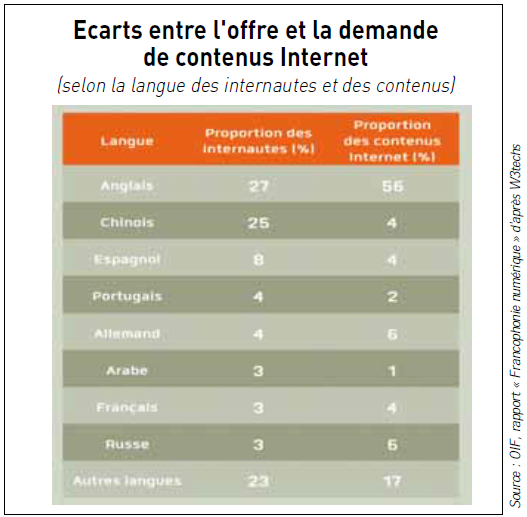

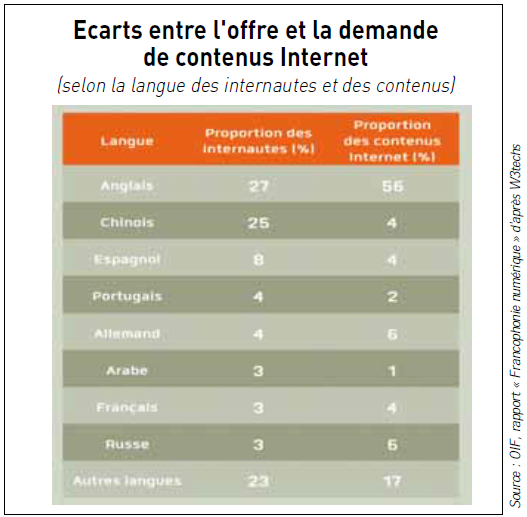

« A première vue, on peut penser que les francophones sont bien servis dans l’univers du numérique. Bien qu’ils ne constituent que 3 % de l’ensemble des internautes, 4 % de l’ensemble des contenus qu’on trouve sur Internet sont en français », constate-t-il.

L’anglais, sureprésenté sur Internet

L’anglais, sureprésenté sur Internet

Mais à y regarder de plus près, l’anglais est la langue la plus surreprésentée sur Internet : « Il y est deux fois plus présent que ne paraît le justifier sa proportion du nombre d’internautes ». Les utilisateurs de langue anglaise représentent en effet 27 % de l’ensemble des internautes, alors que les contenus en anglais pèsent 56 % sur Internet – soit une offre deux fois plus importante que la demande.

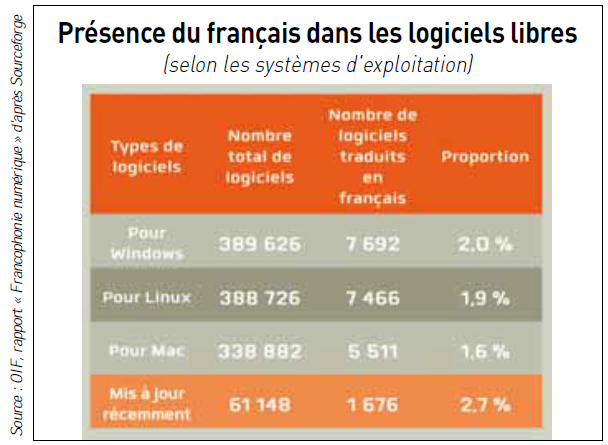

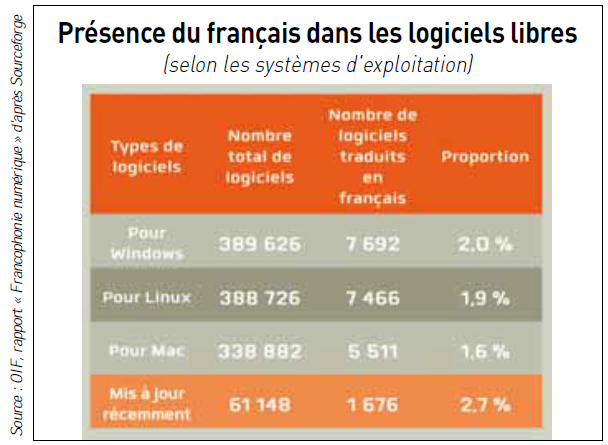

Les francophones, eux, ne représentent que 3 % des internautes mais disposent de contenus en français en proportion avec leur nombre. Encore faut-il que les habitants des 57 pays membres de la francophonie – sur cinq continents – aient bel et bien accès à des contenus numériques de qualité, particulièrement pédagogiques. «Pour que la quantité de contenus numériques de qualité en français et en langues partenaires s’accroisse sur Internet et ailleurs, les acteurs francophones doivent continuer d’investir dans leur production et leur diffusion », recommande vivement ce rapport présenté le 18 mars par secrétaire général de l’Organisation internationale de la francophonie (OIF), Michaëlle Jean (photo). Face aux Etats-Unis qui produisent le plus de contenus sur Internet, portés par les GAFA américains (3), l’OIF en appelle aux gouvernement des pays francophones pour que leurs populations aient accès à des contenus en langue française. Cela passe par la production de contenus, le développement de technologies en français, le soutien à la créativité artistique francophone, mais aussi la production dynamique de contenus en mode collaboratif, à l’image de ceux de l’encyclopédie Wikipédia ou du système de base mondiale de données géographiques OpenStreetMap. « Il faut publier des livres numériques en français. Il faut publier des vidéos en français sur YouTube. Il faut produire des logiciels en langue françaises, notamment dans le logiciel libre [voir tableau ci-contre, ndlr]», a insisté Réjean Roy, chargé de la rédaction du rapport de l’OIF et expert canadien en technologies de l’information.

« Aujourd’hui, nous associons l’Internet mobile à un appareil intelligent qui tourne sur une plateforme spécifique et qui permet d’accéder aux applications que nous utilisons. Bien que cela ait généré des avantages extraordinaires pour les utilisateurs et toute une économie des applications pour les développeurs, les utilisateurs sont prisonniers d’une plateforme et cela limite au final les choix d’une manière inédite pour l’Internet », déplore Michael Kende (photo), chef économiste de l’Internet Society (Isoc) et auteur du rapport « Global Internet Report 2015 » dévoilé le 7 juillet dernier.

« Aujourd’hui, nous associons l’Internet mobile à un appareil intelligent qui tourne sur une plateforme spécifique et qui permet d’accéder aux applications que nous utilisons. Bien que cela ait généré des avantages extraordinaires pour les utilisateurs et toute une économie des applications pour les développeurs, les utilisateurs sont prisonniers d’une plateforme et cela limite au final les choix d’une manière inédite pour l’Internet », déplore Michael Kende (photo), chef économiste de l’Internet Society (Isoc) et auteur du rapport « Global Internet Report 2015 » dévoilé le 7 juillet dernier.